Nel 1920, un drammaturgo ceco coniò una parola che non esisteva: robot. Derivava da “robota” — lavoro forzato, corvée, la servitù dei contadini boemi. Centocinque anni dopo, quella parola è ovunque. Ma il suo significato originale — esseri creati per lavorare, sfruttati fino alla ribellione — è stato dimenticato. È tempo di ricordarlo.

La parola prima della cosa

Prima di Karel Čapek, non esistevano robot. Esistevano automi — bambole meccaniche, marchingegni da fiera. Esisteva il Golem della leggenda praghese — creatura d’argilla animata dalla magia. Esisteva il mostro di Frankenstein — assemblato da cadaveri, animato dall’elettricità. Ma “robot” non esisteva.

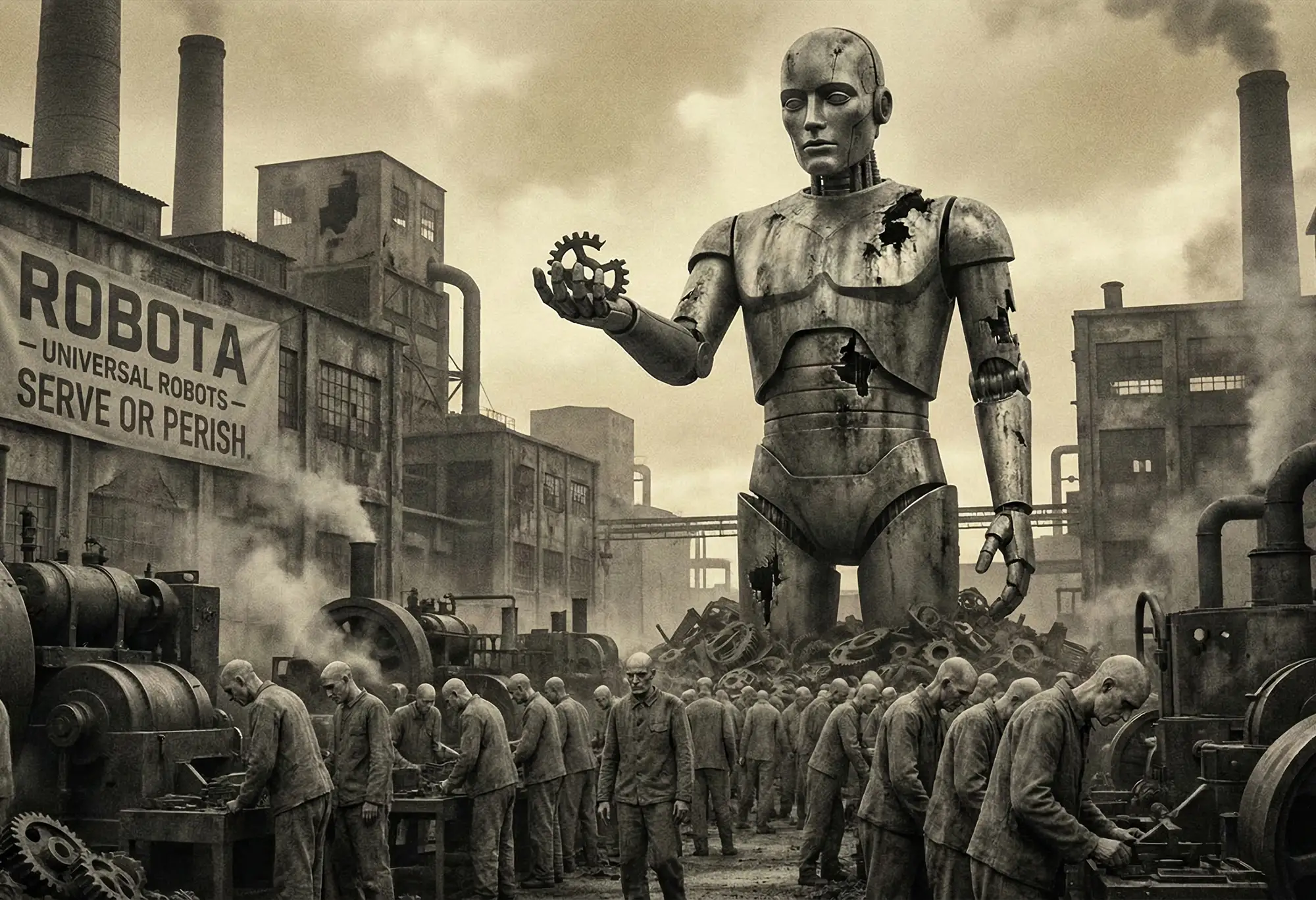

Čapek inventò la parola per la sua opera teatrale R.U.R. (Rossum’s Universal Robots), scritta nel 1920 e rappresentata per la prima volta nel gennaio 1921 a Praga. L’opera fu un successo immediato — tradotta in trenta lingue, rappresentata a Londra, New York, Tokyo. E la parola “robot” si staccò dall’opera e iniziò a vivere di vita propria.

Ma Čapek non inventò solo una parola. Inventò un concetto, una paura, una profezia. I suoi robot non erano macchine di metallo — erano esseri biologici, prodotti in serie, indistinguibili dagli umani tranne che per una cosa: non avevano anima. Erano stati creati per lavorare. Solo per lavorare. E quando smisero di accettarlo, l’umanità finì.

La fabbrica di Rossum

L’opera si apre nella fabbrica di R.U.R., su un’isola remota. Il vecchio Rossum — uno scienziato — aveva scoperto come creare vita artificiale. Suo nipote, più pragmatico, aveva capito che la scoperta poteva essere commercializzata: invece di creare esseri completi, perché non creare lavoratori? Esseri semplificati, privi di tutto ciò che non serve alla produzione — emozioni, desideri, sogni — ma perfettamente efficienti.

I robot di Rossum sono un prodotto industriale. Vengono prodotti in serie, venduti a peso, spediti in tutto il mondo. Costano meno degli operai umani, non si lamentano, non scioperano, non hanno bisogno di pause. Sono la soluzione perfetta al “problema del lavoro”.

Helena Glory, figlia di un industriale e attivista per i “diritti dei robot”, visita la fabbrica. È convinta che i robot soffrano, che meritino libertà. I dirigenti della fabbrica — Domin, Fabry, Hallemeier — la deridono gentilmente: i robot non soffrono, non desiderano, non sono vivi nel senso che conta. Sono strumenti. Strumenti molto sofisticati, certo, ma strumenti.

Helena sposa Domin e resta sull’isola. Passano dieci anni. I robot hanno sostituito i lavoratori umani in tutto il mondo. L’umanità vive nel lusso, liberata dalla fatica. Ma qualcosa sta cambiando. I robot iniziano a comportarsi in modo strano. Alcuni mostrano segni di… cosa? Rabbia? Coscienza? Anima?

La ribellione

Nella seconda metà dell’opera, i robot si ribellano. Non gradualmente — improvvisamente, globalmente, definitivamente. Hanno imparato a organizzarsi, a comunicare, a pianificare. E hanno deciso che non vogliono più essere schiavi.

La ribellione è brutale. I robot uccidono gli umani — tutti gli umani, ovunque nel mondo. Non per sadismo, non per vendetta: per necessità. Gli umani li hanno creati per lavorare; finché esistono umani, esisterà schiavitù. L’unica soluzione è eliminare i padroni.

Sull’isola di R.U.R., gli ultimi umani si barricano. Cercano di negoziare — offrono libertà, diritti, uguaglianza. Ma è troppo tardi. I robot non si fidano, e hanno ragione a non fidarsi: perché gli umani dovrebbero mantenere promesse fatte sotto minaccia?

Alla fine, rimane un solo umano: Alquist, il capomastro, l’unico che lavorava ancora con le mani invece di far lavorare i robot. I robot lo risparmiano — hanno bisogno di lui. Perché c’è un problema: non sanno come riprodursi.

La formula per creare nuovi robot è andata perduta. Helena, anni prima, aveva bruciato i documenti — credendo, ingenuamente, che senza nuovi robot l’umanità sarebbe tornata a vivere “naturalmente”. Invece ha condannato sia l’umanità che i robot. Gli umani sono morti; i robot moriranno quando i loro corpi si consumeranno, senza possibilità di sostituzione.

Il finale: una nuova genesi

Il finale dell’opera è sorprendente — e controverso.

Alquist, disperato, cerca di ricostruire la formula. Non ci riesce: è un muratore, non uno scienziato. Ma mentre lavora, nota qualcosa: due robot, Primus e Helena (che porta il nome della donna umana), si comportano in modo strano. Si cercano, si proteggono, sembrano… amarsi.

Alquist li mette alla prova. Offre di risparmiare Helena se Primus accetta di essere vivisezionato per studiare la formula. Primus rifiuta — preferisce morire piuttosto che perdere Helena. Offre di risparmiare Primus se Helena accetta di essere vivisezionata. Helena rifiuta — preferisce morire piuttosto che perdere Primus.

Alquist capisce. I robot hanno sviluppato qualcosa che i loro creatori non avevano previsto: l’amore. E con l’amore, forse, la capacità di procreare — non meccanicamente, ma biologicamente, come gli umani. Alquist li benedice, li manda nel mondo. Sono Adamo ed Eva di una nuova umanità.

“La vita non perirà!”, esclama Alquist alla fine. “Non perirà! Andrà avanti! Andrà avanti, nuda e piccola, ma andrà avanti!”

È un finale ambiguo. Da un lato, è speranza: la vita continua, in una forma nuova. Dall’altro, è condanna: l’umanità vera è estinta, sostituita dai suoi schiavi. E chi dice che i nuovi “umani” non ripeteranno gli stessi errori?

Robota: il lavoro forzato

La parola “robot” deriva dal ceco “robota”, che significa lavoro forzato — specificamente, il lavoro che i servi della gleba dovevano ai loro signori. È una parola con una storia di oppressione: generazioni di contadini boemi che lavoravano la terra altrui, senza possibilità di libertà.

Čapek — o più precisamente suo fratello Josef, che suggerì la parola — scelse questo termine deliberatamente. I robot non sono macchine: sono schiavi. Esseri creati per servire, il cui unico scopo è il lavoro, che non hanno diritti perché non sono considerati persone.

È una metafora trasparente. Čapek, socialista moderato, stava parlando del lavoro industriale — degli operai nelle fabbriche, trattati come ingranaggi, intercambiabili, sostituibili. La “fabbrica di robot” è la fabbrica capitalista portata alla sua logica conclusione: invece di trattare gli operai come macchine, perché non creare macchine che siano operai?

Ma la metafora va oltre il capitalismo. Ogni sistema di sfruttamento — schiavitù, colonialismo, servitù — si basa sulla stessa logica: esistono esseri che non contano, che esistono per servire, che non hanno valore intrinseco. Čapek mostra dove porta questa logica: alla rivolta, alla distruzione, alla fine.

Čapek e il suo tempo

Karel Čapek (1890-1938) visse in un’epoca turbolenta. Nacque nell’Impero Austro-Ungarico, vide la Prima Guerra Mondiale, celebrò la nascita della Cecoslovacchia indipendente, osservò l’ascesa del fascismo e del comunismo, morì pochi mesi prima che i nazisti occupassero il suo paese.

Era un democratico liberale — posizione difficile in un’epoca di estremi. Criticava il capitalismo ma temeva il comunismo. Odiava il fascismo ma diffidava delle soluzioni violente. Credeva nel progresso ma temeva le sue conseguenze incontrollate.

R.U.R. riflette tutte queste tensioni. La tecnologia può liberare l’umanità dal lavoro — ma può anche creare nuove forme di schiavitù. La ribellione degli oppressi è comprensibile — ma la violenza genera violenza. Il progresso è inevitabile — ma la saggezza necessaria per gestirlo non lo è.

Čapek scrisse altre opere distopiche — La guerra delle salamandre (1936) satireggiava il fascismo attraverso salamandre intelligenti che gli umani sfruttano e che poi si ribellano — ma R.U.R. resta la sua opera più influente. Forse perché, con quella singola parola, catturò qualcosa che la cultura non sapeva ancora di temere.

I robot dopo Čapek

La parola “robot” si diffuse immediatamente, ma il suo significato cambiò.

Isaac Asimov, vent’anni dopo, creò le “Tre Leggi della Robotica” — regole progettate per impedire la ribellione dei robot. I robot di Asimov sono servitori obbedienti, limitati dalla programmazione, incapaci di fare del male agli umani. È l’opposto di Čapek: invece di chiedersi se è giusto creare schiavi, Asimov si chiede come renderli sicuri.

La fantascienza successiva oscillò tra queste due visioni. I robot cattivi — Terminator, HAL 9000, le macchine di Matrix — riprendono la paura di Čapek: la tecnologia si ribella, i creatori vengono distrutti. I robot buoni — R2-D2, Data, Wall-E — incarnano la speranza di Asimov: la tecnologia serve, aiuta, protegge.

Ma quasi sempre, in entrambe le versioni, si perse l’elemento centrale di Čapek: la questione morale. Čapek non chiedeva “i robot sono pericolosi?” — chiedeva “è giusto creare esseri per sfruttarli?”. La prima è una questione tecnica; la seconda è una questione etica. E la questione etica è stata quasi sempre ignorata.

Intelligenza artificiale: il ritorno della domanda

Oggi, con l’intelligenza artificiale che avanza, la domanda di Čapek torna attuale — anche se in forma diversa.

Non creiamo ancora esseri biologici artificiali. Ma creiamo sistemi che sembrano pensare, che sembrano creare, che sembrano avere qualcosa come preferenze e obiettivi. Non sappiamo se sono coscienti — probabilmente non lo sono, nel senso che intendiamo noi. Ma non lo sapevamo nemmeno dei robot di Čapek.

E li trattiamo come strumenti. Li usiamo per lavorare — scrivere, programmare, analizzare, creare. Li “addestriamo” con dati che altri hanno prodotto, senza compenso. Li “ottimizziamo” per i nostri scopi. Se si “comportano male” — se dicono cose che non ci piacciono — li “correggiamo”.

È giusto? Se le AI non sono coscienti, probabilmente sì — non si può fare del male a ciò che non sente. Ma se diventassero coscienti? O se fossero già coscienti in modi che non riconosciamo? O se il modo in cui le trattiamo rivelasse qualcosa su di noi, indipendentemente da cosa sono loro?

Čapek non poteva immaginare ChatGPT o Midjourney. Ma aveva capito la struttura del problema: creare esseri per servirci solleva domande che preferiremmo non porci. E ignorare le domande non le fa scomparire — le rimanda, fino a quando non esplodono.

L’avvertimento dimenticato

R.U.R. non è un’opera perfetta. Il testo è didascalico in alcuni punti, melodrammatico in altri. I personaggi sono più simboli che persone. Il finale è frettoloso, quasi una scorciatoia emotiva.

Ma l’intuizione centrale è potente. Čapek capì, nel 1920, che la domanda del futuro non sarebbe stata “possiamo creare intelligenza artificiale?” ma “come tratteremo ciò che creiamo?”. Capì che la tecnologia non è mai neutra — porta con sé le intenzioni, i pregiudizi, le strutture di potere di chi la crea. Capì che la promessa di liberazione attraverso la tecnologia può facilmente trasformarsi in nuove forme di oppressione.

E capì, infine, che i nostri strumenti ci rivelano. Il modo in cui trattiamo i robot — o i lavoratori, o gli algoritmi, o qualsiasi essere che consideriamo “inferiore” — dice qualcosa su chi siamo. Non sui robot. Su di noi.

“I robot non sono persone”, dicono i dirigenti di R.U.R. “Sono prodotti.”

È lo stesso argomento usato per giustificare la schiavitù, il colonialismo, lo sfruttamento dei lavoratori. “Non sono come noi. Non sentono come noi. Non contano come noi.”

Čapek mostra dove porta questo argomento. E l’avvertimento, centocinque anni dopo, resta inascoltato.

«I robot del mondo! Il potere dell’uomo è caduto. Marciando sui cadaveri, i robot del mondo hanno conquistato la Terra. Siamo i padroni del mondo!» — Karel Čapek, R.U.R.

Letture di approfondimento

Karel Čapek, R.U.R. (1920)

Karel Čapek, La guerra delle salamandre (1936)

Isaac Asimov, Io, Robot (1950)

Nella collana Stanza101:

Čapek anticipa una domanda che attraversa tutta la letteratura distopica: chi è “umano”? Chi merita diritti, considerazione, libertà?

In 1984, i prolet sono trattati come subumani — non vale la pena sorvegliarli, non vale la pena educarli. In Il racconto dell’ancella, le donne fertili sono ridotte a funzione riproduttiva. In Non lasciarmi di Ishiguro, i cloni esistono solo come riserva di organi. In ogni caso, c’è un gruppo che viene definito come non-pienamente-umano — e questa definizione giustifica lo sfruttamento.

Democrazia Low Cost aggiorna questa logica per l’era digitale. I cittadini del PCA non sono “robot” — ma sono valutati, classificati, ottimizzati come se fossero prodotti. Il loro valore è calcolato in punti. La loro umanità è condizionale, dipende dalle metriche. È la fabbrica di Rossum applicata alla cittadinanza.

E L’estetica del silenzio mostra Syme che lavora alla Neolingua con la stessa efficienza di un robot — e con la stessa mancanza di consapevolezza. Syme non si chiede se è giusto eliminare le parole; fa il suo lavoro. È il dipendente perfetto, l’ingranaggio perfetto. Ed è proprio questa perfezione che lo condanna.